erklärt von Ralf Colbus

„IBM Storage untergliedert sich in vier strategische Kernbereiche, die wir mit Auswirkungen weiterentwickeln werden. Damit beantworten wir die Fragen in einem neuen Markt, in dem veränderte Speicher-Technologien, Datenwachstum und neue Betriebsmodelle Einzug halten. Die Mechanismen, die wir bisher verwendet haben, um Rechenzentren, Infrastrukturen und Storagesysteme zu gestalten, haben sich radikal gewandelt – es werden jetzt komplett neue Rechenzentrums-Landschaften entstehen.

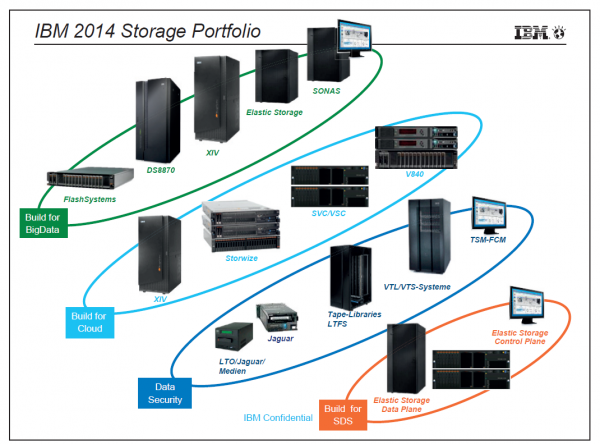

Abbildung 1: IBM Storage Portfolio eingeteilt nach häufi gsten Kunden-Scenarios für die Bereiche BigData, Cloud, Security sowie SDS – Software Defi ned Storage um das alles zu managen.

Neuerungen mit IBM Storage Announcements Q4 2014

- Elastic Storage: based on POWER-Technology

- Storwize: SVC, V7000/V7000Unified

- SONAS: NAS-Erweiterungen

- TS1150: neues HE Tape-Drive

- Flash V840: Effizienz-Feature

- DS8000: neue Drive Optionen

Die vier strategischen Kernbereiche sind:

- Software Defined Storage

- Flash Technologie

- Virtualisierung und

- Data Protection und Retention

Wir verwenden unsere Storage Virtualisierung um bestehende Storage Systeme in eine Software Defined Storage Landschaft zu überführen. Es gibt bereits weit über 60tsd. Einheiten der IBM Storage Virtualisierung im Markt. Durch Analytics-SW werden Kunden jetzt mit der Virtualisierung gezielt Storage-Optimierungsvorschläge erhalten. Der Storage-Betrieb wird einfacher, schneller und kostengünstiger. In diesem Marktsegment sind wir Marktführer!

IBM wird auch in Zukunft klassische „Appliance“ Storage Systeme entwickeln und fertigen. Wir werden jedoch deutlich mehr Storage Systeme als reine Software Lösungen konzipieren. Diese entwerfen wir für unsere Kunden ganz gezielt im Himblick auf die Anwendungsbereiche Cloud, Analytics, Mobile oder Social Media.

Der Flash Bereich, auf den ich noch zurückkommen werde, ist ein Bereich, den wir seit 2012 sehr erfolgreich ausbauen, so dass wir inzwischen ebenfalls Marktführer in diesem Bereich sind.

Bei Data Protection und Retention geht es in Zukunft darum, diese neuen großen Datenbestände an unstrukturierten Daten so zu sichern, dass man sie auch sehr schnell wiederherstellen kann. Hier arbeiten wir gerade an Systemen und Komponenten die wir im nächsten Jahr verstärkt vorstellen, die in der Lage sind sehr sehr große Datenmengen sehr schnell zu sichern und zu restoren. Das klassische Backup ist bei einigen Kunden jetzt an eine Grenze gestossen, wo es nicht mehr optimal funktioniert. Ein klassisches Backup sieht typischerweise so aus, dass wir einen Backup Server haben. Wir sichern dann unseren konsistenten Datenbestand zum Beispiel über SnapShot-Portalund das ist sehr schnell zu restoren. Zur Datensicherung verwenden wir ferner Point-and-Shoot-Technologie und außerdem wird über bestimmte Client-APIs gesichert.

Inzwischen haben wir jedoch wie gesagt bei manchen Kunden den Punkt erreicht, wo die täglichen Datenmengen dafür einfach zu groß werden. Einige Großkunden schaffen es einfach aus zeitlichen Gründen nicht mehr, die gewünschten anfallenden Daten zu sichern – dabei geht es um eine Größenordnung von 500 TB pro Tag.

Interessant ist die Tatsache, dass wir bei einigen sehr großen Kunden für das Backup-Umfeld Flash Systeme einsetzen. Das ist unter Kostenaspekten eine zunächst überraschende Problemlösung, aber damit kann man die Backup- Zeiten von etlichen Stunden auf ein paar Minuten reduzieren. Wir bauen teilweise Flash Systeme mit 120–150TB für dediziertes Backup / Restore ein. Es steht ausser Zweifel, dass wir in Zukunft neue Datenansätze und neue Infrastrukturen brauchen, um diese großen quirligen Datenbestände überhaupt zu bewegen und zu sichern.

Wenn wir über diese Form der Datensicherung nachdenken, müssen wir den ganzen Integrated Solution Stack einbeziehen. Angefangen bei der kompletten Applikation, über das Betriebssystem, bis runter auf die einzelne Plattenebene bzw. das entsprechende Medium, müssen wir den gesamten Stack von oben nach unten sichern. Um eine Wiederverwendbarkeit und weitere Auswertbarkeit der Daten zu gewährleisten, muss der Stack komplett vorhanden sein, er muss integriert sein. Hier geht es um den Integrationsgedanken.

Um den neuen Anforderungen gerecht zu werden, haben wir das gesamte Storage Portfolio überarbeitet. Wir haben die Systemkomponenten nach den Anforderungen der Bereiche „Big Data“, „Cloud“ und „Data Security“ geordnet und den vierten Bereich „SDS“ – der ebenfalls weiter ausgebaut wird – geschaffen, um das ganze zu managen. (siehe Abb. 1)

Die System Komponenten für den Bereich Big Data zeichnen sich dadurch aus, dass sie extrem performant sein müssen, zum Beispiel im Zusammenhang mit Flash sekundenschnelle Antwortzeiten liefern und auch für einige Kunden bis in den PB-Bereiche hinein extrem hoch skalieren, um Daten vorzuhalten.

Unsere Kunden arbeiten inzwischen mit hochkapazitiven Festplatten, die natürlich auch irgendwann ausfallen. Deshalb ist es so wichtig, dass wir für diese Umgebungen dank dieser Exabyte- Storage sehr schnelle Recovery Zeiten für Festplatten ermöglichen, um Datenumverteilung bei guter Performance leisten können. Im TB-Bereich kann man noch klassische RAID Algorithmen für die Datenherstellung nutzen, dies scheitert aber irgendwann wenn die Größenordnung in die PB oder sogar Exabyte- Bereiche ragt. Inzwischen arbeiten unsere Kunden mit 6TB großen Festplatten, so dauert in einem großen RAID-System die Recovery Tage, wenn in einem solchen System einmal eine Festplatte ausfällt.

Die Systemkomponenten zum Thema Cloud zeichnen sich dadurch aus, dass sie vollkommen virtualisiert arbeiten und die entsprechenden Cloud-APIs (Schnittstellen) besitzt.

Im Bereich Software Defined Storage (SDS) sehen Sie 3 Produkte, die dazu dienen, diese ganzen Welten zu verbinden. Abb. 1

Wichtige technische Neuerungen haben wir jetzt neben den neuen Komponenten im FlashSystem V840 (Abb. 5) auch in der Storwize Familie (Abb. 6) vorgestellt. Was da besonders spannend ist, das ist die Datenkomprimierung, denn es geht hier um das Einsparpotential beim Kunden. Dieser Algorithmus und die dazugehörige Hardware ist inzwischen unglaublich schnell geworden und wir können in Kundenumgebungen Datenbanken, ERP Systeme oder VDI-Umgebungen – Produktionsdaten, also nicht nur Archiv- oder File-Daten – Beispiel im SAP-Umfeld in real-time komprimieren und speichern. (RtC, Real time Compression). Wir erzielen dabei bis zu 80 % Einspar-Potenzial!

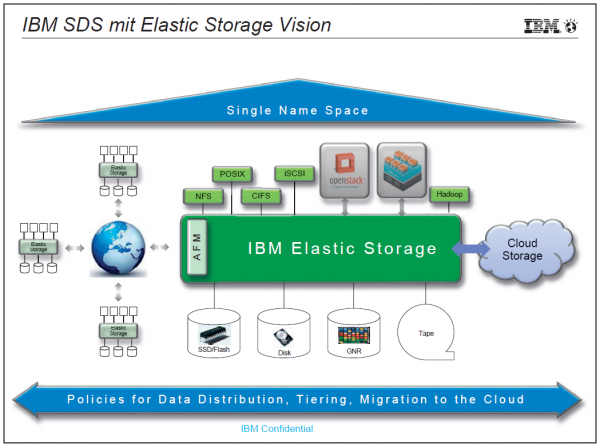

Ferner nähert sich unsere Vision von Software Defined Storage mit Elastic Storage (Abb. 2) mit diesem Announcement noch weiter ihrer Vollendung. Für Software Defined Storage führen wir mit diesem Announcement ein neues Speichersystem ein, den IBM Elastic Storage Server – ESS (Abb. 3). Dabei setzen wir auf POWER8, nutzen die Rechenleistung und die angeschlossenen JBOD-Festplatten als einfache HW bei der die gesamte Speicher-Funktionalität in der Software über dieser Hardware liegt. Die SW sorgt für die RAID-Kalkulation, die Spiegel-Funktionalität und die Möglichkeit globale-Dateizugriffe zu regeln. Mit diesem Ansatz und können hoch-skalierbare Speichersysteme aufgebaut werden.

Nächstes Jahren werden wir dann Daten transparent vom Elastic Storage direkt mit der Cloud verbinden können. Insgesamt fehlen uns jetzt von diesem Elastic Storage Visions-Bild nur noch 2 oder 3 Funktionen.

Das Virtual Storage Center – VSC (Abb. 4) ist die Plattform, um SDS Umgebung zu managen, zu verwalten, Speicher zuzuteilen und zu optimieren. VSC unterstützt jetzt auch den IBM ESS sowie die IBM Flashsysteme.

Das kann jetzt die Virtual Storage Center (VSC) Software. Hervorheben möchte ich den Analytic-driven Tiered Storage Optimizer, bei dem eine COGNOS Engine im Hintergrund

mitläuft. Diese Software gibt dem Administrator konkrete Empfehlungen, d.h. sie gibt zum Beispiel sinngemäß folgende Meldung aus: Bei der Überprüfung der Workload habe ich hier einen teuren Speicher entdeckt, der fast nicht genutzt wird und es wäre viel besser, diese Applikation mit dem User-Traffic hinüberzubewegen auf den günstigsten Speicher, um ein besseres Kostenverhältnis zu erzielen und wenn Du willst, Administrator, dann drücke jetzt auf OK und ich mache das alles für Dich. Solche Helferlein betreiben eine hervorragende Optimierung der Storage-Landschaft.

Letztlich möchte ich noch als strategisches Produkt auf das neue Tape Drive TS1150 (Abb. 7) als Highlight hinweisen. Das Tape Drive hat jetzt eine um 2,5fach größere Kapazität und eine Verbesserung des Durchsatzesum 44 %. Wir werden an Tape Technologien festhalten und diese weiter ausbauen. In Rüschlikon, bei uns in der Schweiz, läuft bereits ein Tape Drive mit einer 150TB Cartridge. Daran sieht man, welche Sprünge die Tape- Technik noch vor sich hat.“

Texte aus den Abbildungen

IBM Virtual Storage Center v5.2.3 What’s New

- unterstützt jetzt IBM Elastic Storage Server

- IBM FlashSystem V840: Provisionierung und Performance Management

- IBM DS8000:Multi-target Metro Mirror Replikationen mit Hyperswa

- Analytic-driven Tiered Storage Optimizer

- einfache Provisionierung mit OpenStack Cinder und VMware vCenter APIs

- vereinfachtes Snapshot-Management mit IBM FlashCopy Manager

IBM® FlashSystem V840 What’s New:

- V840 und 840 System-Management SW:

• 300-Tage Performance Reporting

• Health Monitoring

• Performance Reporting mit vordefinierten Reports (IOps, Latency, Bandbreite etc) - V840:

• 2x höhere RtC Performance durch Dual-Engine Compression Accelerator Cards - TPC/VSC Support für erweitertes SRM

- Scale-up/-out mit: 320 TB @ 2.4M IOps oder 1.6PB @ 1.4M IOps mit RtC (5:1)

IBM® Storwize® Family What’s New

- V7000/Unified G2:

• Encryption für Block-Daten at Rest (XTS-AES 256)

• ohne Performanceverlust mit Standard HDD/SSD - RtC –Erweiterung V7000/Unified und SVC:

• Dual SW- Compression Engine für RtC sorgt für bis zu 2x bessere Performance - 16Gbps FCP für V7000/Unified und SVC

- T10 DIF support für V7000 G2

- Neue Drives für V3000-V5000-V7000:

• 6 TB 7.2 krpm und 1.5 TB 10krpm - SoD (Statement of Direction):

• Encryption support für SVC

• Integration in IBM-TKLM Konzept

IBM® TS1150 What’s New

- größere Kapazität: 2.5x mehr als TS1140

• 10 TB native Kapazität mit neuer JD-Kassette

• 7 TB mit re-use JC Kassette (anstatt 4 TB) - 360 MBps Durchsatz: 44% Verbesserung (360MB/s vs. 250MB/s)

- 8Gbps FCP support

- 14 Digital Speed matching Stufen

- 2 GB Datenpuffer mit Read-ahead

- verbesserte Kompression

- Investitionsschutz:

• Upgrade von TS1140 und Media Re-use

• supported in TS3500 und TS4500 Tapelibraries

• momentan noch Open systems only

IBM® SONAS v1.5.1 What’s New

- Protokoll-Erweiterungen

• NFS v2, v3, v4 und SMB 2.1 (CIFS) - Verfügbarkeit und Sicherheit:

• File-Immutability: WORM Funktion (per RPQ)

• ACE Multiwriter: Globale Kollaboration durch erweitertes File- und Directory-Sharing

• interoperabel mit V7000 Unified G2